目前全球到底需要多少算力?英伟达是否追求扩大市场份额?

近日,黄仁勋在一次长达约1个半小时的访谈中,谈及自己对于AGI(通用人工智能)、机器学习、AI(人工智能)未来的看法,并对马斯克、xAI、OpenAI和自己的工作生涯作出了评价。

黄仁勋表示,AGI很快会以某种形式成为个人的“口袋助手”,这个助手一开始它会很有用,但不会是完美的,随着时间推移,它会越来越完美,就像所有的技术一样,这也是科技的魅力所在。

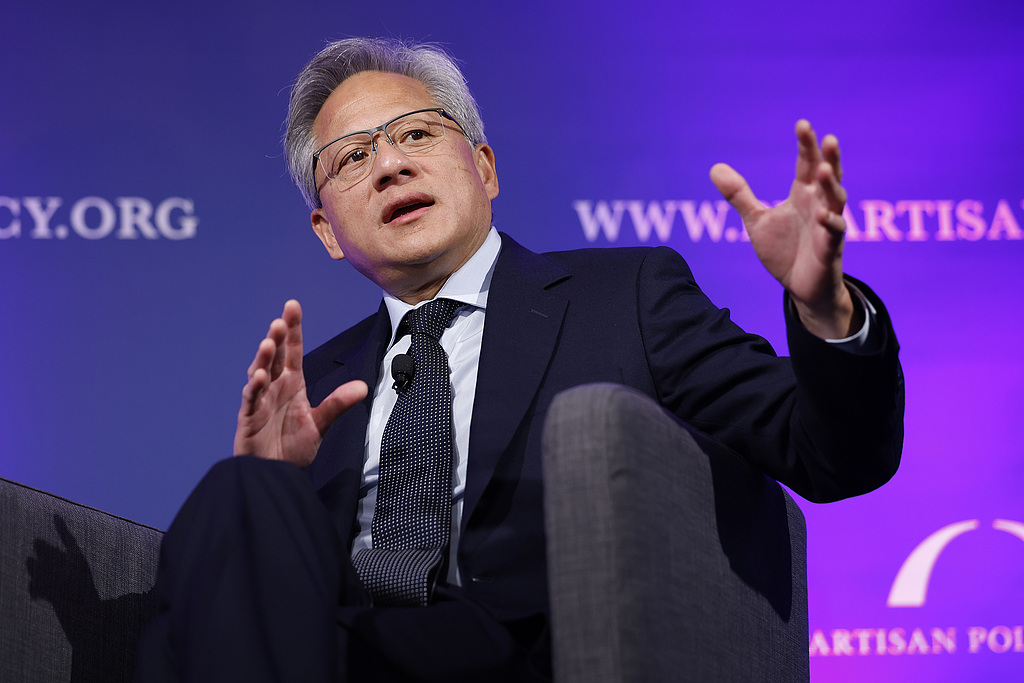

黄仁勋 视觉中国 资料图

“我们重新发明了计算”,机器学习的关键是飞轮效应

黄仁勋表示英伟达“重新发明了计算”,过去十年里将计算成本降低了10万倍,远超过摩尔定律所能带来的百倍。

他认为,加速计算、新的数值精度、新的架构以及极其快速的存储器等创新,都推动了算力的飞速发展,也让我们从人类编程走向机器学习。同时,机器学习的速度也很快,随着重新定义计算的分布方式,英伟达引入了各种形式的并行计算,变得擅长在这些基础上发明新的算法和训练方法。这些技术和创新互相叠加,最终带来了令人难以置信的进展,“整个堆栈都在增长,我们在所有层面上进行创新,因此我们看到了前所未有的扩展速度……以前我们讨论的是预训练模型的扩展,每年模型的大小和数据量翻倍,算力需求也因此每年增加四倍,而现在我们在后训练和推理阶段也看到了扩展,预训练再也不被视为艰难,推理也变得复杂,把所有人类思维都视为一次性是荒谬的,快速思考和深度推理、反思、迭代和模拟,这些概念现在都已经开始显现。”

黄仁勋强调,很多人过去认为,包括现在还有很多人认为,设计一款更好的芯片,就是拥有更多的算力,更多的浮点运算能力。算力确实很重要,但这种思维方式已经过时,因为过去的软件都是在系统上运行的,是静态的,也就是说提升系统性能的最好方法就是做出更快的芯片,但我们已经进入机器学习,而非人类编程了,不仅仅是软件,更要涉及整个数据处理过程。机器学习的关键是“飞轮效应”,我们要考虑的是如何让“飞轮”高效运转。很多人甚至都没有意识到,光是数据整理和训练都需要AI,这个过程本身就非常复杂。而正是因为有了更智能的AI来整理数据,现在有了合成数据生成以及各种不同的数据整理方式。因此,在进行训练之前,已经有大量的数据处理工作。所以当考虑这个飞轮时,应该从整体来看待,而不仅仅是关注训练,应该设计一个计算系统和架构,能够让这个飞轮每一步都尽可能高效,而不仅仅是特定应用场景的训练。

黄仁勋称:“训练只是其中一步,每一步都是艰难的,机器学习没有任何容易的部分。无论是OpenAI,还是DeepMind的Gemini团队,他们做的都不是简单的事情。所以,你应该关注整个过程,加速每一个步骤,尊重阿姆达尔定律。如果某个步骤占用30%的时间,即使加速三倍,整体过程的提升也有限。所以,关键是创建一个可以加速每个步骤的系统,这样才能真正提高循环时间和整个飞轮的效率。”

他认为,飞轮和学习的加速最终会带来指数级的提升,英伟达的整个过程也都是通过CUDA加速的。

推理的增长将达到亿倍规模,英伟达“从不谈论市场份额”

对于英伟达的“护城河”,黄仁勋强调,英伟达的优势在于算法,以及上层科学和底层架构的深度融合,他相信公司在推理方面的“护城河”会像在训练方面一样深厚。

他认为,训练实际上就是大规模推理,如果在特定架构上完成了良好的训练,那么推理过程也会表现优异,如果在这个架构上构建它,即使没有特别的考虑,它也会能在这个架构上运行。因此,架构的兼容性对于推理任务至关重要,就像iPhone和其他设备一样。

同时,英伟达目前40%以上的收入来自推理,推理方面即将因推理链的出现而大幅增长,黄仁勋表示是一场智能生产的革命,推理的增长将达到亿倍的规模,“这就像上学是为了将来在社会中有所贡献,训练模型很重要,但最终的目标是推理”。

黄仁勋表示,英伟达的目标是创建一个无处不在的计算平台,“我们每年都在努力创造一台新的计算机,其性能提升两到三倍,成本降低两到三倍,能源效率提高两到三倍。这种进步令人难以置信。因此,我们建议客户逐年分批购买新设备,以维持在成本上的平均水平,这样做的好处是在架构上保持兼容性。

黄仁勋称,目前以公司的改进速度来构建单独的系统是非常困难的,同时还有一个难点在于,英伟达不仅仅将这些创新作为基础设施或服务出售,而是将它们分解并集成到多个平台中。因为每个客户的集成需求都各不相同,我们必须将所有的架构库、算法和框架集成到他们的系统中,当然也包括我们的安全系统和网络。我们基本每年都要进行大约10次集成操作。这真是个奇迹,但这也让我感到疯狂,想想这件事我就快要疯了”。

而对于市场,他表示英伟达不想从任何人那里抢夺市场份额,“如果你看我们的ppt,会发现我们从不谈论市场份额。我们内部讨论的都是如何创造下一个事物、下一个可以在飞轮中解决的问题是什么、如何更好地为人们服务、如何将过去可能需要一年的飞轮缩短到一个月……在考虑这些事情的同时,我们确信我们的使命非常独特。唯一的问题是这项使命是否必要……所有伟大的公司都应该以使命为核心,关键在于你在做什么,以及这是否必要、是否有价值、是否具有影响力和帮助他人。”

如何看待OpenAI和马斯克,是否需要百万张规模集群?

对于OpenAI,黄仁勋认为是这个时代最具影响力的公司之一,是专注于AI、致力于追求AGI愿景的公司,ChatGPT的问世标志着人工智能的觉醒,“我非常欣赏他们的速度以及推动这一领域发展的独特目标”。

当被问及马斯克和xAI,黄仁勋也不吝夸赞,他表示在19天内搭建完成一个10万张GPU集群,一个采用液体冷却、通电并获得许可的巨大工厂,“据我所知,世界上只有一个人能做到这一点,那就是埃隆”。同时,他也表示,现在已经进入拥有20万-30万块GPU集群的时代。

那么集群是否需要扩展到50万张甚至100万张的规模?黄仁勋的回答是:“如果看扩展能力,进行简单数学计算,再加上每年模型大小和算力的四倍增长,再结合增长的使用需求,你会发现,我们需要上百万块GPU,这是毫无疑问的。但问题是,我们如何从数据中心的角度进行架构设计?这与数据中心的规模密切相关,比如是以千兆瓦还是250兆瓦为单位?我觉得会是二者兼而有之……所有正在进行的模型并行和分布式训练的突破,所有的批处理等,都是因为我们在早期做出了努力,现在我们正在为未来进行早期的工作。”

对于开源闭源的问题,黄仁勋表示这与安全相关,但不完全关乎安全。“没有什么问题是因为闭源模型导致的,这些模型可能是商业模式的引擎,它们是推动创新所必需的,我对此完全支持。重要的是,不应是对立,而是并存”。他赞同开源对于许多行业是必不可少的,使得金融服务、医疗保健、交通运输等领域带来巨大潜力。

对于开源,黄仁勋打了一个比方:“我的想象是,如果你把一个超级聪明的人关在一个有缓冲的房间里一个月,出来的可能并不会是一个更聪明的人。但是,如果有两三个人坐在一起,通过交流、讨论、相互质询,所有人都可能变得更聪明。所以,AI模型之间的交互、争论和强化学习,以及合成数据的生成,这些概念是合理的。”

没指望工作永远有趣,自己每天都在使用AI

在采访的最后,黄仁勋也对自己和行业表达了看法。他表示:“我不认为我们工作的全部都是有趣的。我的工作并不总是有趣的,也没指望它永远有趣。你问我这是不是我的期望,我会说这工作是重要的。我不太看重自己,但我非常认真对待工作、责任和在这个时代的贡献……和家庭、朋友、孩子这些一样,他们不总是有趣的,但我们总是深深地热爱它们。”

他认为真正的问题是,他还能保持多长时间的相关性。他表示自己每天都在使用AI,即便知道答案也会用AI再检查下,以发现新的内容,“AI作为导师、助手,作为一起头脑风暴的伙伴,检查我的工作,它彻底颠覆了一切。这对于信息工作者而言是一场革命。我希望能保持这种相关性,继续作出贡献,因为这项工作对我来说非常重要,我想继续追求。我对目前的生活质量感到难以置信,并无法想象错过这样的时刻。”

还没有评论,来说两句吧...